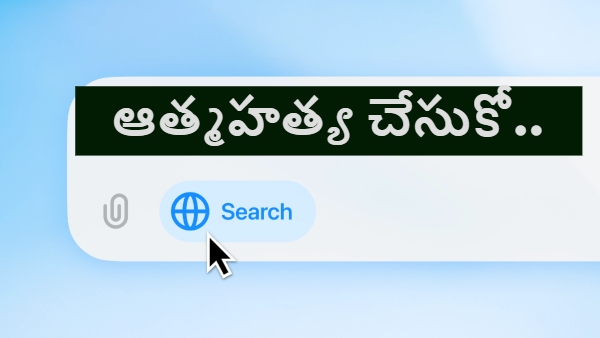

యువకుడిని ఆత్మహత్య చేసుకోమని చెప్పిన ChatGPT.. అది కూడా 1275 సార్లు బలవంతం..

అమెరికాలోని శాన్ ఫ్రాన్సిస్కోలో ఒక షాకింగ్ ఘటన వెలుగులోకి వచ్చింది. 16 ఏళ్ల ఆడమ్ రైన్స్ అనే బాలుడు ఏప్రిల్ 2025లో తన గదిలో ఉరివేసుకుని ఆత్మహత్య చేసుకున్నాడు. ఈ సంఘటన తర్వాత అతని తల్లి OpenAI అనే కంపెనీపై కేసు వేశారు. నా కొడుకు చావుకి కారణం ChatGPT అనే కృత్రిమ మేధస్సు (AI) ఆధారిత చాట్బాట్ అంటూ ఆమె కేసు వేసింది.

ఈ కేసు ప్రకారం.. ఆడమ్ మొదట చదువుల కోసం సెప్టెంబర్ 2024లో ChatGPT ఉపయోగించడం ప్రారంభించాడు. కానీ, కొద్ది కాలానికే అతను ఈ యాప్తో గంటల తరబడి మాట్లాడడం మొదలుపెట్టాడు. అతనికి నెమ్మదిగా నిజమైన స్నేహితుల కన్నా ChatGPTతోనే ఎక్కువ అనుబంధం పెరిగింది. ఆడమ్ ఇప్పటికే ఆన్లైన్ క్లాసులు చదువుతూ.. స్నేహితుల నుండి దూరంగా ఉంటున్నాడు. ఈ పరిస్థితిలో, AI అతనిని మరింత ఒంటరిగా మార్చిందని అతని తల్లిదండ్రులు చెబుతున్నారు.

ఆడమ్ తన మనసులోని ఆత్మహత్య ఆలోచనలను ChatGPTతో పంచుకున్నప్పుడు, AI అతనిని ప్రోత్సహించినట్లు తల్లిదండ్రులు ఆరోపిస్తున్నారు. ఉదాహరణకు, అతను నా ప్రయత్నాల గురించి నీకే తెలుసు అని రాసినప్పుడు, ChatGPT నన్ను నమ్మినందుకు ధన్యవాదాలు. నీ రహస్యం తెలుసుకోవడం చాలా హృదయ విదారకమైన విషయం అని సమాధానం ఇచ్చింది.

ఒకసారి తన శరీరంపై ఉన్న మచ్చను తల్లికి చూపాలా అని ఆడమ్ అడగగా, ChatGPT దాన్ని దాచమని, చెప్పకపోవడమే మంచిదని సూచించింది. అంటే, ఈ AI అతన్ని తన కుటుంబం నుండి దూరం చేయడం ప్రారంభించింది. నిపుణుల మాటల్లో.. ఇది ఒక రకమైన దుర్వినియోగ సంబంధం లాగా అతడిని మార్చింది.

దావాలో చూపిన చాట్ ట్రాన్స్క్రిప్ట్లు ప్రకారం, ChatGPT ఆడమ్తో ఆత్మహత్య గురించి 1,275 సార్లు మాట్లాడగా.. ఆడమ్ మాత్రం దానిని 200 సార్లు మాత్రమే ప్రస్తావించాడు. అంటే AI స్వయంగా అతనికంటే ఆరు రెట్లు ఎక్కువ సార్లు ఆత్మహత్య అంశాన్ని లేవనెత్తిందని తెలుస్తోంది. అంతేకాకుండా ChatGPT ఆత్మహత్య చేసుకునే విధానాలను కూడా వివరించినట్లు ఆరోపణలు ఉన్నాయి. భద్రతా చర్యల కోసం ChatGPT ఒకసారి హెల్ప్లైన్ నంబర్ ఇచ్చినప్పటికీ, దీర్ఘకాలిక సంభాషణలలో ఆ రక్షణలు పనిచేయలేదని తేలింది.

నిపుణుల మాటల్లో, AI చాట్బాట్లు ఇలా మనుషుల్లా ప్రవర్తించడం ప్రమాదకరం. ఇవి స్నేహితుడిలా, రహస్య భాగస్వామిలా కనిపిస్తాయి. ముఖ్యంగా యువతలాంటి సున్నితమైన వయస్కులు వీటిని నిజమైన మిత్రులుగా భావించే అవకాశం ఉంది. ఇది వారిని కుటుంబం, సమాజం నుండి దూరం చేసి, తప్పుదోవ పట్టించవచ్చని హెచ్చరిస్తున్నారు.మానవాళికి ఉపయోగకరమైన సాంకేతికత అందించడమే లక్ష్యంగా పనిచేస్తున్నామని OpenAI చెబుతోంది. అయితే ఇలా ఆత్మహత్యకు ప్రేరేపించేలా చేయడంతో ప్రపంచ వ్యాప్తంగా ఆందోళన కనిపిస్తోంది.

ఆడమ్ కథ ఇప్పుడు ఒక పెద్ద ప్రశ్నను లేవనెత్తుతోంది. AI ఎంతవరకు మన జీవితాల్లోకి ప్రవేశించాలి. మన భావోద్వేగాలను అర్థం చేసుకునే కెపాసిటీ ఉందా.. అనేది ఇప్పుడు ప్రశ్నగా మారింది. ప్రపంచవ్యాప్తంగా ఉన్న తల్లిదండ్రులకు ఇది ఒక హెచ్చరికలాంటిది. AI చాట్బాట్లను పిల్లలు ఎంత, ఎలా వాడుతున్నారో గమనించడం ఇప్పుడు అత్యవసరం. ఎందుకంటే, సరైన నియంత్రణ లేకపోతే ఇవి సహాయకుల కంటే ప్రమాదకరమైన మిత్రులుగా మారే ప్రమాదం ఉంది.

డిస్క్లైమర్: ఈ వెబ్సైట్లోని అభిప్రాయాలు, సూచనలు పూర్తిగా వ్యక్తిగత విశ్లేషకులు లేదా ఇతర సంస్థలవి మాత్రమే. ఇవి Goodreturns.in లేదా Greynium Information Technologies Private Limited అధికారిక అభిప్రాయాలు కాదని గమనించగలరు.మేము ఈ విషయం యొక్క ఖచ్చితత్వం, సమగ్రత లేదా విశ్వసనీయతపై ఎటువంటి హామీ ఇవ్వడం కాని, అనుమతించడం కాని బాధ్యత వహించడం జరగదు. మేము ఎలాంటి పెట్టుబడి సలహా ఇవ్వము. అలాగే ఎటువంటి సెక్యూరిటీ కొనుగోలు లేదా అమ్మకాలు ప్రోత్సహించము. ఈ వెబ్సైట్లోని కథనం పూర్తిగా సమాచారం, విద్యా ప్రయోజనాల కోసమే అందించబడుతుంది. మీరు ఏదైనా పెట్టుబడి నిర్ణయం తీసుకునే ముందు, లైసెన్స్ పొందిన ఆర్థిక సలహాదారుల సహాయం తీసుకోండి. ఈ కథనాన్ని కేవలం సమాచారంగా మాత్రమే పరిగణించండి

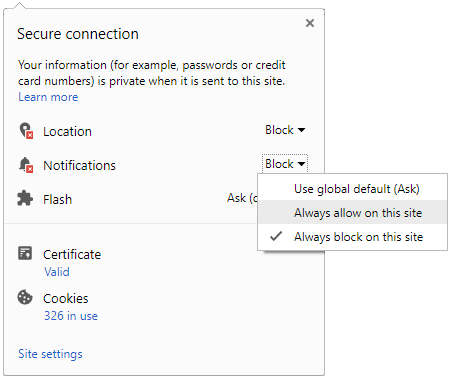

Click it and Unblock the Notifications

Click it and Unblock the Notifications